|

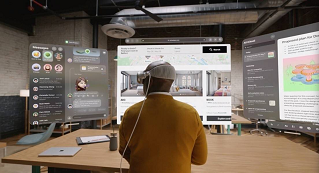

Cuatro funciones nuevas de las

gafas Vision Pro de Apple

La Oficina de Patentes y Marcas de Estados Unidos reveló cuatro

peticiones de patente de Apple, las cuales están relacionadas al uso

de gestos manuales para interactuar con objetos virtuales al

utilizar unas Vision Pro.

Encender lámparas con gestos

La primera de una serie de cuatro patentes se llama “Activación de

elementos procesables mediante gestos manuales”.

Esta describe un sistema que trabaja de la siguiente manera: primero

recoge imágenes del entorno usando una cámara. Después, el sistema

busca en esas imágenes objetos con las que se pueda interactuar, y a

cada una le asigna una acción diferente.

Si el sistema ve que una mano hace un movimiento específico hacia

uno de esos objetos, como una señal, entonces responde llevando a

cabo la acción que corresponde a ese objeto en particular.

Un ejemplo dentro del documento de la patente es el de una lámpara

en el escritorio del usuario. Su luz se encendería con un simple

toque de los dedos de la persona si está utilizando un aparato Head-Mounted

Display (HMD) o pantalla montada en la cabeza, como Apple Vision

Pro.

Detectar objetos fuera del campo de vista

|

|

El dispositivo Apple Vision Pro, que viene con

cámaras, altavoces, procesadores y una memoria duradera, puede notificar al

usuario con sonidos. Esto ocurre de la siguiente forma:

Primero, las cámaras capturan una imagen de algún lugar. El HMD reconoce si hay

un

objeto presente en la imagen.

Luego verifica si ese objeto no está a la vista del usuario. Si resulta que está

fuera del campo visual de la persona, Apple Vision Pro utiliza los altavoces

para emitir un sonido y avisarle al usuario que hay algo que no está viendo.

Sensores especiales

La tercera solicitud de patente presenta un sistema que funciona así:

La cámara saca fotos de lo que está alrededor de la persona. Después, el sistema

del Apple Vision Pro transforma esas fotos en sonidos. Por último, estos sonidos

se escuchan a través del altavoz que está conectado a la parte que se inserta en

el oído.

Esto se podría implementar de las siguientes maneras:

- Traducción de señales o texto visual en audio: Apple Vision Pro podría leer y

convertir señales de tráfico o menús de restaurantes en audio para el usuario.

- Interacción mejorada con la realidad aumentada: el dispositivo tendría la

capacidad de proporcionar información sobre puntos de interés o negocios

cercanos al usuario al pasar por ellos.

Avisos de bloqueo de vista

El método sencillo para identificar si algo

|

|

está

bloqueando la cámara en Apple Vision Pro funcionaría así:

El HMD toma una foto del lugar con su cámara. Después, se fija si algo está

obstruyendo la cámara y no deja que vea bien.

A continuación, decide qué tipo de cosa está haciendo la obstrucción. Una vez

que sabe qué es lo que está tapando la cámara, Apple Vision Pro utiliza sus

altavoces para emitir un sonido especial que le avisa al usuario del bloqueo.

El recorrido de Apple

Apple Vision Pro fue anunciado el 5 de junio de 2023, en la Apple Worldwide

Developers Conference de 2023, y estará disponible para su compra a principios

de 2024 por $3.499 estadounidenses y se enviarán inicialmente aproximadamente

1.000.000 de unidades.

En 2022 circulaban rumores sobre un dispositivo de Apple, entonces llamado

Reality Pro. Bloomberg informó en mayo que líderes de Apple, incluyendo a Tim

Cook, vieron un prototipo.

En junio, iniciaron la búsqueda de directores para crear contenido, contratando

a Jon Favreau para un programa de dinosaurios en Apple TV+.

En enero de 2023, el mismo medio señaló un retraso en el lanzamiento del

dispositivo de realidad aumenta. Se reveló en abril que Apple estaba motivando a

desarrolladores para crear aplicaciones para el mismo.

|